Inhaltsverzeichnis:

- Schritt 1: Prinzip der Verwendung von Farben zur Darstellung von Wellen

- Schritt 2: Erstellen Sie den Sound to Color Converter

- Schritt 3: Erstellen Sie einen RGB-Druckkopf

- Schritt 4: Besorgen oder bauen Sie einen XY-Plotter oder ein anderes 3D-Positionierungssystem (Fusion360 Link enthalten)

- Schritt 5: An einen Lock-in-Verstärker anschließen

- Schritt 6: Fotografieren und teilen Sie Ihre Ergebnisse

- Schritt 7: Führen Sie wissenschaftliche Experimente durch

- Schritt 8: Versuchen Sie es unter Wasser

- Autor John Day day@howwhatproduce.com.

- Public 2024-01-30 07:18.

- Zuletzt bearbeitet 2025-01-23 12:52.

Von SteveMannEyeTap Humanistische IntelligenzFolgen Sie mehr vom Autor:

Über: Ich bin zu einer Zeit aufgewachsen, als Technologien transparent und leicht verständlich waren, aber jetzt entwickelt sich die Gesellschaft in Richtung Wahnsinn und Unverständlichkeit. Also wollte ich Technik menschlich machen. Im Alter von 12 Jahren habe ich… Mehr über SteveMann »

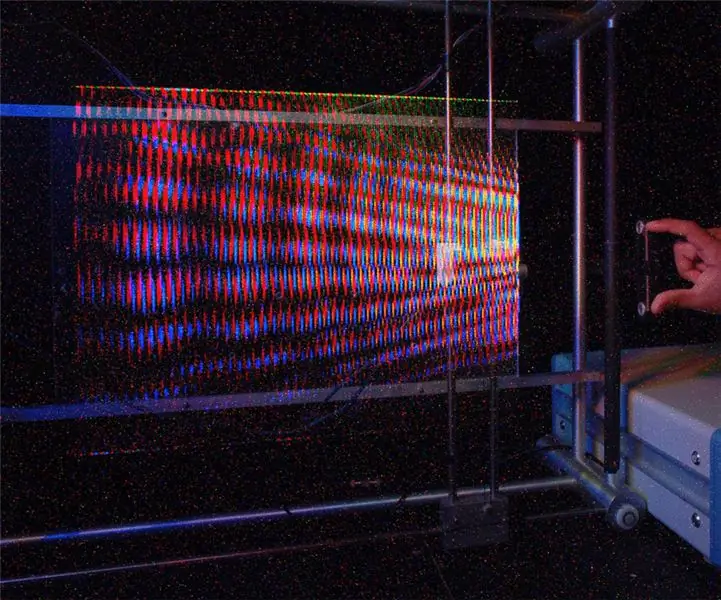

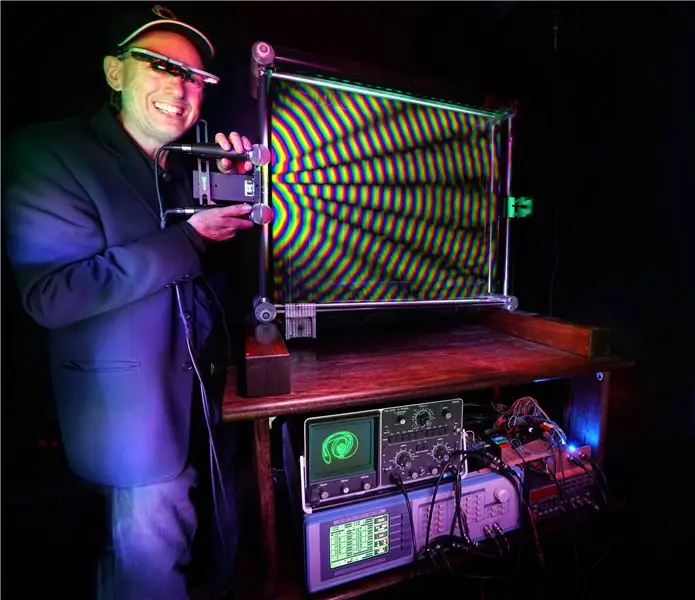

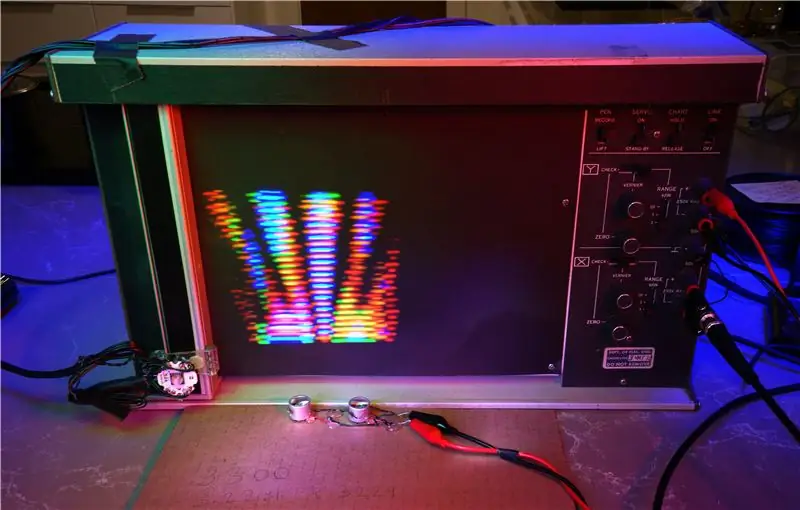

Hier können Sie Schallwellen sehen und die Interferenzmuster von zwei oder mehr Wandlern beobachten, wenn der Abstand zwischen ihnen variiert wird. (Ganz links, Interferenzmuster mit zwei Mikrofonen bei 40.000 Zyklen pro Sekunde; oben rechts, einzelnes Mikrofon bei 3520 cps; unten rechts, einzelnes Mikrofon bei 7040 cps).

Die Schallwellen treiben eine Farb-LED an, und die Farbe ist die Phase der Welle und die Helligkeit ist die Amplitude.

Ein X-Y-Plotter wird verwendet, um die Schallwellen aufzuzeichnen und Experimente zur phänomenologischen Augmented Reality ("Real Reality"™) mittels einer Sequential Wave Imprinting Machine (SWIM) durchzuführen.

DANKSAGUNGEN:

Zuerst möchte ich die vielen Menschen anerkennen, die bei diesem Projekt geholfen haben, das als Hobby meiner Kindheit begann, Radiowellen und Schallwellen zu fotografieren (https://wearcam.org/par). Vielen Dank an viele ehemalige und gegenwärtige Studenten, darunter Ryan, Max, Alex, Arkin, Sen und Jackson und andere im MannLab, darunter Kyle und Daniel. Danke auch an Stephanie (Alter 12) für die Beobachtung, dass die Phase von Ultraschallwandlern zufällig ist, und für die Hilfe bei der Entwicklung einer Methode, sie nach Phase in zwei Stapel zu sortieren: ``Stephative'' (Stephanie positiv) und ``Stegative' “(Stephanie negativ). Vielen Dank an Arkin, Visionertech, Shenzhen Investment Holdings und Professor Wang (SYSU).

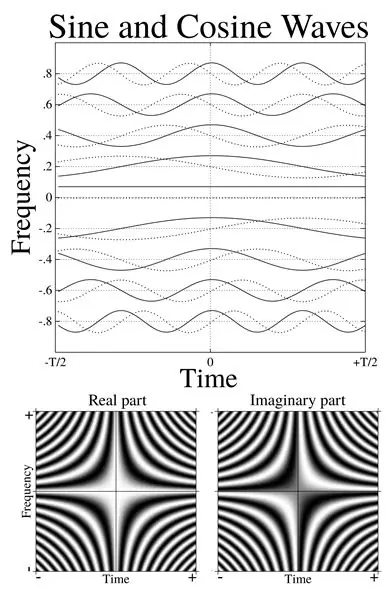

Schritt 1: Prinzip der Verwendung von Farben zur Darstellung von Wellen

Die Grundidee besteht darin, Farben zu verwenden, um Wellen, wie beispielsweise Schallwellen, darzustellen.

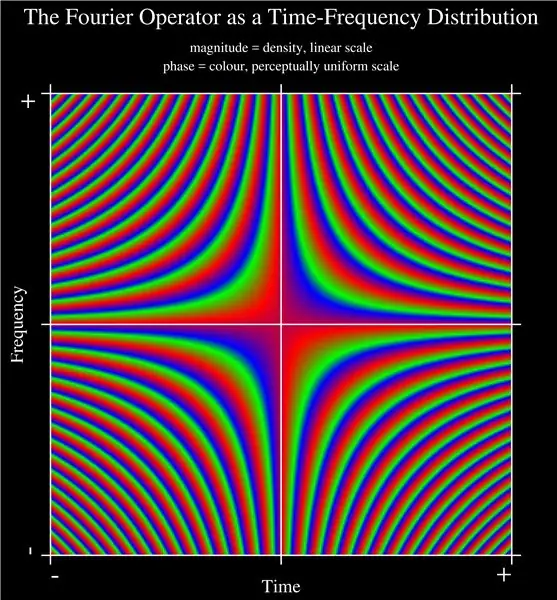

Hier sehen wir ein einfaches Beispiel, in dem ich Farbe verwendet habe, um elektrische Wellen darzustellen.

Dies ermöglicht es uns, zum Beispiel die Fourier-Transformation oder jedes andere wellenbasierte elektrische Signal visuell zu visualisieren.

Ich habe dies als Buchcover verwendet, das ich entworfen habe [Advances in Machine Vision, 380 S., April 1992], zusammen mit einigen Kapiteln zum Buch.

Schritt 2: Erstellen Sie den Sound to Color Converter

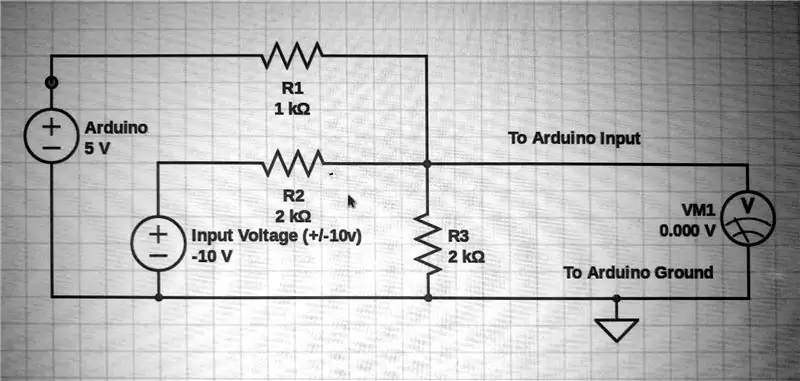

Um Ton in Farbe umzuwandeln, müssen wir einen Ton-in-Farb-Konverter erstellen.

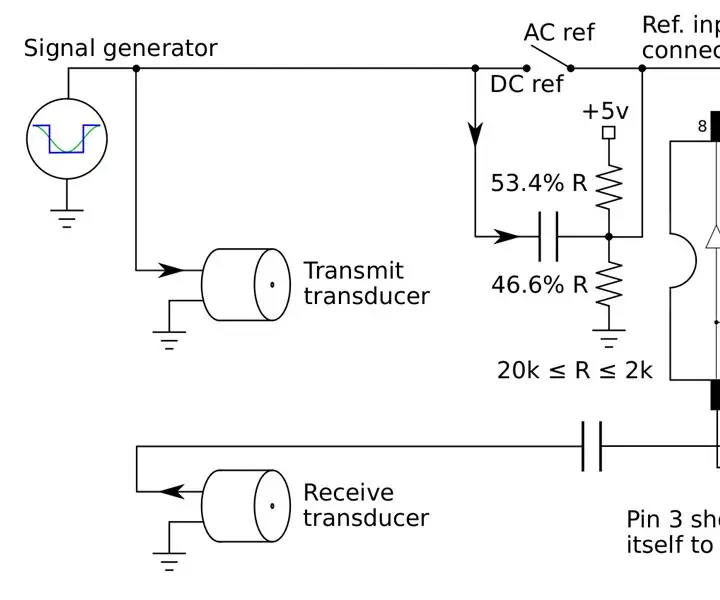

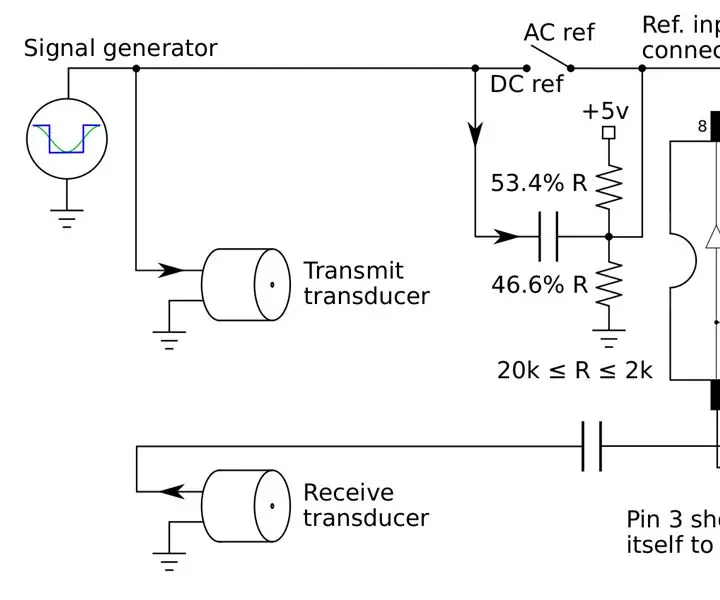

Der Ton kommt vom Ausgang eines Lock-In-Verstärkers, der sich auf die Frequenz der Schallwellen bezieht, wie in einigen meiner früheren Instructables sowie in einigen meiner veröffentlichten Papiere erläutert.

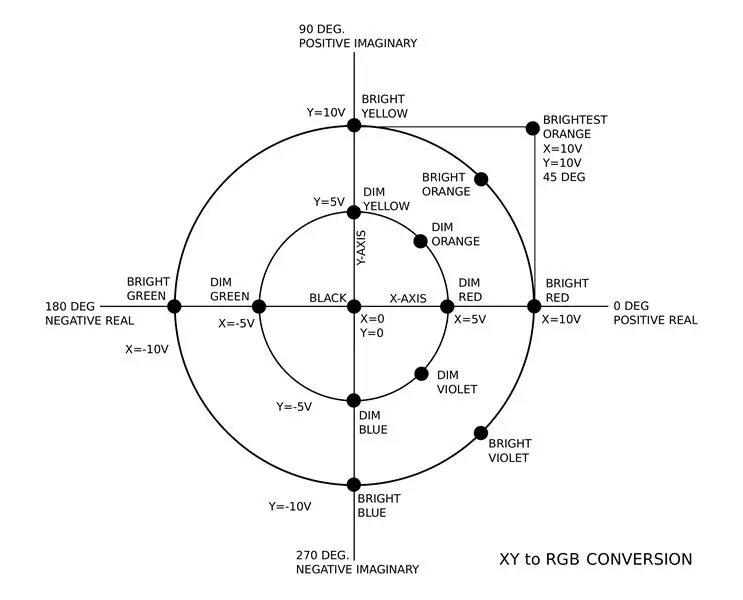

Der Ausgang des Lock-In-Verstärkers ist ein komplexwertiger Ausgang, der an zwei Anschlüssen erscheint (viele Verstärker verwenden BNC-Anschlüsse für ihre Ausgänge), einen für "X" (die gleichphasige Komponente, die der Realteil ist) und einen für "Y" (die Quadraturkomponente, die der Imaginärteil ist). Zusammen stellen die an X und Y anliegenden Spannungen eine komplexe Zahl dar, und die obige Zeichnung (links) zeigt die Argand-Ebene, auf der komplexwertige Größen als Farbe dargestellt werden. Wir verwenden ein Arduino mit zwei analogen Eingängen und drei analogen Ausgängen, um von XY (komplexe Zahl) in RGB (Rot, Grün, Blau) umzuwandeln, gemäß dem mitgelieferten Swimled.ino-Code.

Diese bringen wir als RGB-Farbsignale an eine LED-Lichtquelle. Das Ergebnis ist ein Farbkreis mit Phase als Winkel und mit der Lichtqualität die Signalstärke (Schallpegel). Dies geschieht mit einer komplexen Zahl zum RGB-Color-Mapper wie folgt:

Der komplexe Farb-Mapper wandelt eine komplexwertige Größe, die typischerweise von einem Homodyn-Empfänger oder Lock-In-Verstärker oder phasenkohärenten Detektor ausgegeben wird, in eine farbige Lichtquelle um. Normalerweise wird mehr Licht erzeugt, wenn die Stärke des Signals größer ist. Die Phase beeinflusst den Farbton der Farbe.

Betrachten Sie diese Beispiele (wie im IEEE-Konferenzpapier "Rattletale" beschrieben):

- Ein starkes positives reelles Signal (d. h. wenn X = +10 Volt) wird als helles Rot codiert. Ein schwach positives reelles Signal, d. h. bei X = +5 Volt, wird als schwaches Rot codiert.

- Die Nullausgabe (X=0 und Y=0) präsentiert sich schwarz.

- Ein starkes negatives Realsignal (d. h. X = -10 Volt) ist grün, während ein schwach negatives Realsignal (X = -5 Volt) schwach grün ist.

- Stark imaginäre positive Signale (Y=10v) sind hellgelb und schwach positiv-imaginäre (Y=5v) sind schwachgelb.

- Negativ imaginäre Signale sind blau (z. B. helles Blau für Y=-10v und schwaches Blau für Y=-5v).

- Allgemeiner gesagt ist die erzeugte Lichtmenge ungefähr proportional zu einer Größe R_{XY}=\sqrt{X^2+Y^2} und die Farbe zu einer Phase, \Theta=\arctan(Y/X). Ein Signal, das gleichermaßen positiv reell und positiv imaginär (dh \Theta=45 Grad) ist, ist schwach orange, wenn es schwach ist, helles Orange bei starkem (zB X = 7,07 Volt, Y = 7,07 Volt) und hellstes Orange bei sehr starkem, dh X = 10 V und Y = 10 V, in diesem Fall leuchten die R (rot) und G (grün) LED-Komponenten voll. In ähnlicher Weise wird ein Signal, das gleichermaßen positiv reell und negativ imaginär ist, als lila oder violett dargestellt, d. Dies erzeugt je nach Signalstärke ein schwaches oder helles Violett.[link]

Die Ausgänge X = Augmented Reality und Y = Augmented Imaginality jedes phasenkohärenten Detektors, Lock-In-Verstärkers oder Homodyn-Empfängers werden daher verwendet, um einem Sichtfeld oder Sichtfeld eine phänomenologisch erweiterte Realität zu überlagern, wodurch ein Grad von. angezeigt wird akustische Reaktion als visuelle Überlagerung.

Besonderer Dank geht an einen meiner Studenten, Jackson, der mir bei der Implementierung meines XY-zu-RGB-Konverters geholfen hat.

Das obige ist eine vereinfachte Version, die ich gemacht habe, um es einfach zu lehren und zu erklären. Die ursprüngliche Implementierung, die ich in den 1980er und frühen 1990er Jahren gemacht habe, funktioniert noch besser, weil sie den Farbkreis in einer wahrnehmungsmäßig einheitlichen Weise verteilt. Siehe angehängte Matlab-.m-Dateien, die ich Anfang der 1990er Jahre geschrieben habe, um die verbesserte XY-zu-RGB-Konvertierung zu implementieren.

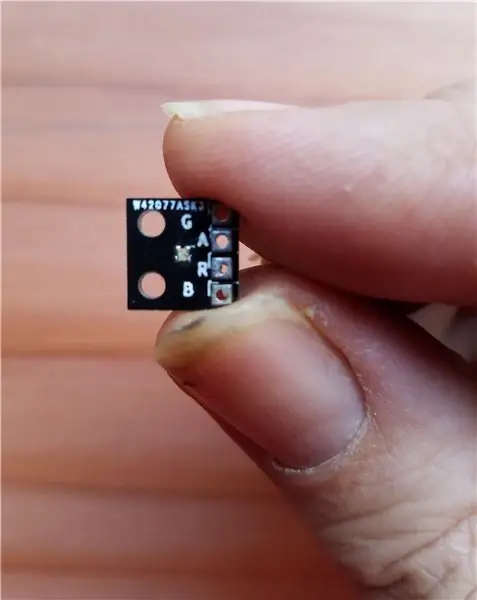

Schritt 3: Erstellen Sie einen RGB-Druckkopf

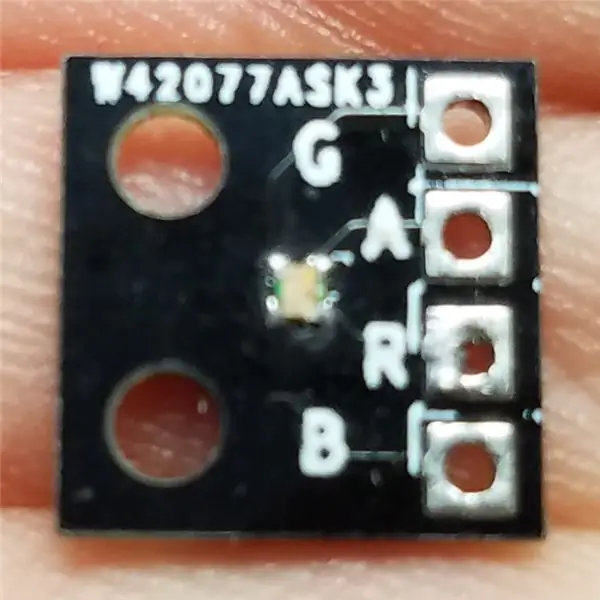

Der "Druckkopf" ist eine RGB-LED mit 4 Drähten zum Anschluss an den Ausgang des XY-zu-RGB-Konverters.

Verbinden Sie einfach 4 Drähte mit der LED, einen mit Masse und einen mit jedem der Anschlüsse für die Farben (Rot, Grün und Blau).

Besonderer Dank geht an meinen ehemaligen Schüler Alex, der beim Zusammenbauen eines Druckkopfes geholfen hat.

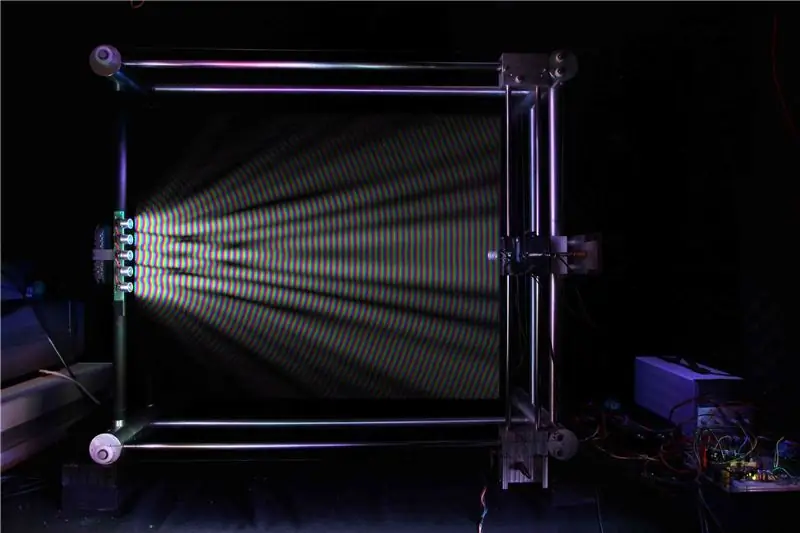

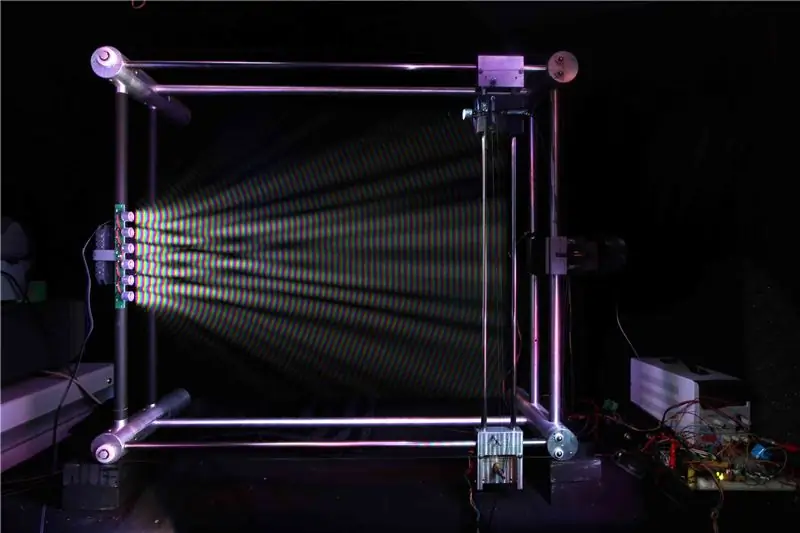

Schritt 4: Besorgen oder bauen Sie einen XY-Plotter oder ein anderes 3D-Positionierungssystem (Fusion360 Link enthalten)

Wir benötigen eine Art 3D-Positionierungsgerät. Ich ziehe es vor, etwas zu erhalten oder zu bauen, das sich leicht in der XY-Ebene bewegt, aber ich benötige keine leichte Bewegung in der dritten (Z) Achse, da dies ziemlich selten vorkommt (da wir normalerweise in einem Raster scannen). Was wir hier haben, ist also in erster Linie ein XY-Plotter, der jedoch lange Schienen hat, die es ermöglichen, ihn bei Bedarf entlang der dritten Achse zu bewegen.

Der Plotter tastet den Raum ab, indem er einen Wandler zusammen mit einer Lichtquelle (RGB-LED) durch den Raum bewegt, während der Verschluss einer Kamera für die richtige Belichtungsdauer geöffnet ist, um jedes Bild des visuellen Bildes (ein oder mehrere) aufzunehmen Bilder, zB für eine Standbild- oder Filmdatei).

XY-PLOTTER (Fusion 360-Datei). Die Mechanik ist einfach; jeder XYZ- oder XY-Plotter ist ausreichend. Hier ist der Plotter, den wir verwenden, 2-dimensionale SWIM (Sequential Wave Imprinting Machine): https://a360.co/2KkslB3 Der Plotter bewegt sich leicht in der XY-Ebene und bewegt sich in Z umständlicher, so dass wir fegen Bilder in 2D ausgeben und dann langsam in der Z-Achse vorrücken. Der Link führt zu einer Fusion 360-Datei. Wir verwenden Fusion 360, weil es Cloud-basiert ist und uns die Zusammenarbeit zwischen MannLab Silicon Valley, MannLab Toronto und MannLab Shenzhen über 3 Zeitzonen hinweg ermöglicht. Solidworks ist dafür nutzlos! (Wir verwenden Solidworks nicht mehr, weil wir zu viele Probleme mit der Versionsverzweigung über Zeitzonen hinweg hatten, da wir früher viel Zeit damit verbracht haben, verschiedene Bearbeitungen von Solidworks-Dateien zusammenzusetzen. Es ist wichtig, alles an einem Ort zu halten, und Fusion 360 macht das wirklich gut.)

Schritt 5: An einen Lock-in-Verstärker anschließen

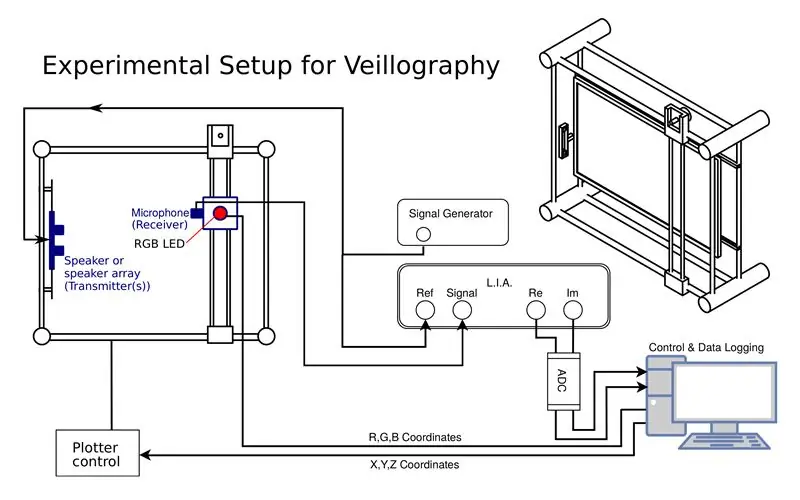

Die Vorrichtung misst Schallwellen in Bezug auf eine bestimmte Referenzfrequenz.

Die Schallwellen werden im gesamten Raum mit Hilfe eines Mechanismus gemessen, der ein Mikrofon oder einen Lautsprecher durch den Raum bewegt.

Wir können das Interferenzmuster zwischen zwei Lautsprechern sehen, indem wir ein Mikrofon zusammen mit der RGB-LED durch den Raum bewegen, während wir fotografische Medien der sich bewegenden Lichtquelle aussetzen.

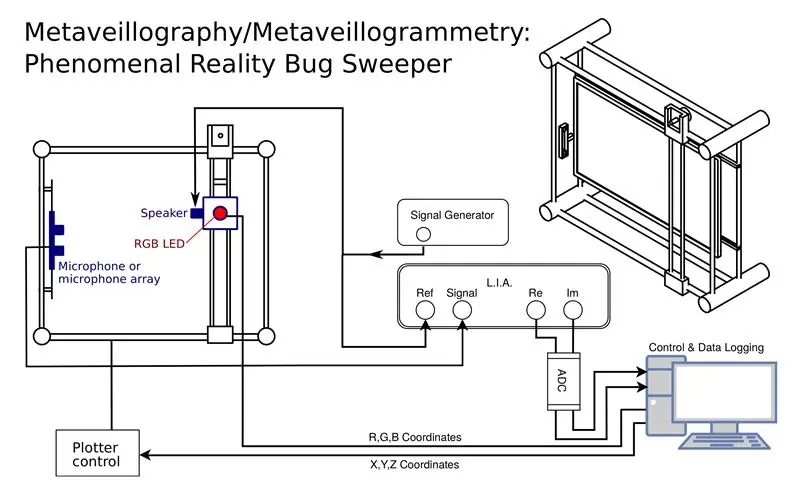

Alternativ können wir einen Lautsprecher durch den Raum bewegen, um die Hörfähigkeit einer Reihe von Mikrofonen zu fotografieren. Dadurch entsteht eine Art Bug-Sweeper, der die Fähigkeit von Sensoren (Mikrofonen) erkennt.

Das Erfassen von Sensoren und das Erfassen ihrer Wahrnehmungsfähigkeit wird als Metaveillance bezeichnet und in der folgenden Forschungsarbeit ausführlich beschrieben:

ANSCHLIESSEN:

Die Bilder in diesem Instructable wurden aufgenommen, indem ein Signalgenerator an einen Lautsprecher sowie an den Referenzeingang eines Lock-In-Verstärkers angeschlossen wurde, während eine RGB-LED zusammen mit dem Lautsprecher bewegt wurde. Ein Arduino wurde verwendet, um eine Fotokamera mit der sich bewegenden LED zu synchronisieren.

Der hier verwendete spezifische Lock-In-Verstärker ist das SYSU x Mannlab Scientific Outstrument™, das speziell für Augmented Reality entwickelt wurde, obwohl Sie Ihren eigenen Lock-In-Verstärker bauen können (ein Hobby meiner Kindheit war das Fotografieren von Schallwellen und Radiowellen, also ich haben zu diesem Zweck eine Reihe von Lock-In-Verstärkern gebaut, wie in beschrieben

wearcam.org/par).

Sie können die Rolle von Sprecher(en) und Mikrofon(en) austauschen. Auf diese Weise können Sie Schallwellen oder Metaschallwellen messen.

Willkommen in der Welt der phänomenologischen Realität. Weitere Informationen finden Sie auch unter

Schritt 6: Fotografieren und teilen Sie Ihre Ergebnisse

Eine kurze Anleitung zum Fotografieren von Wellen finden Sie in einigen meiner vorherigen Instructables wie:

www.instructables.com/id/Seeing-Sound-Wave…

und

www.instructables.com/id/Abakography-Long-…

Viel Spaß und klicken Sie auf "Ich habe es geschafft", um Ihre Ergebnisse zu teilen, und ich gebe Ihnen gerne konstruktive Hilfe und Tipps, wie Sie Spaß an der phänomenologischen Realität haben können.

Schritt 7: Führen Sie wissenschaftliche Experimente durch

Hier sehen wir zum Beispiel einen Vergleich zwischen einem 6-Element-Mikrofon-Array und einem 5-Element-Mikrofon-Array.

Wir können sehen, dass bei einer ungeraden Anzahl von Elementen früher eine schönere zentrale Keule entsteht, und daher manchmal "weniger ist mehr" (z. B. 5 Mikrofone sind manchmal besser als sechs, wenn wir versuchen, Beamforming durchzuführen).

Schritt 8: Versuchen Sie es unter Wasser

Zweiter in den Farben des Regenbogens Wettbewerb

Empfohlen:

Solar-wiederaufladbares Licht herstellen – wikiHow

So stellen Sie wiederaufladbares Solarlicht her:

Machen Sie ein einfaches Bewegungssensor-Licht! (PIR): 13 Schritte (mit Bildern)

Machen Sie ein einfaches Bewegungssensor-Licht! (PIR): Machen Sie eine kleine & Einfaches Bewegungssensorlicht mit weniger Aufwand und weniger Komponenten. Ein Anfänger könnte dies auch machen. Ein einfaches Verständnis der Funktionsweise von Transistoren und Kenntnisse über Anode und Kathode sind nur erforderlich, um es spannungsfrei zu machen

Wie man ein automatisches Licht macht – wikiHow

Wie man ein automatisches Licht macht: Dies ist eine einfache automatische Lichtschaltung

Achtung, fertig, los! Licht: 7 Schritte (mit Bildern)

Achtung, fertig, los! Light: Dies ist ein Projekt, an dem ich derzeit für meinen lokalen Kampfrobotik-Club arbeite. Es ist ein LED-Lichtsystem, das den Fahrern signalisiert, wann das Spiel beginnt. Hier sind die Ziele, die ich anstrebte: - Erscheint physisch ähnlich wie ein Verkehr im älteren Stil

Inventar - Schnelle PC-Diagnose jetzt abgelöst, siehe unten: 6 Schritte

Inventar - Schnelle PC-Diagnose jetzt abgelöst, siehe unten: Wenn Sie jemals an einem PC arbeiten müssen, der sich nicht vor Ihnen befindet, benötigen Sie eine genaue Inventarisierung. Dieses instructable kam rein, weil ein Kollege Schwierigkeiten hat, einen Treiber für einen PC zu finden. Ich werde Aida32 Personal von http://majorgeeks.com verwenden